Marcello Pamio

Oggi vero e falso sono la stessa cosa,

talmente identici da non essere più distinguibili,

e anzi hanno finito per farsi intercambiabili.

Il tormentone estivo quest'anno non è una canzone di Mahamood, ma un’applicazione per il cellulare.

L’app che sta facendo letteralmente impazzire il cyberspazio, vip compresi, si chiama «FaceApp».

Una applicazione prodotta nel 2017 dalla società «Wireless Lab OOO» con sede a San Pietroburgo, fondata da un certo Yaroslav Goncharov.

Nel mondo sempre più persone la stanno usando e i numeri parlano da soli: «oltre 80 milioni di utenti attivi». Così almeno è quanto scritto nel sito ufficiale.

Cos'ha di così attraente FaceApp?

Innanzitutto l’utilizzo è facilissimo e immediato: una volta scaricata gratuitamente da PlayStore o AppleStore, basta farsi una fotografia in primo piano (selfie) con il cellulare e poi ci penserà l’applicazione a trasformarla con dei filtri appositi.

Fin qui nulla di strano: esistono centinaia di programmi di grafica che modificano e alterano le foto, per cui cosa c’è di speciale in questa?

Per capirlo è necessario conoscere il cuore e il cervello di «FaceApp»: potenti algoritmi di Intelligenza Artificiale! Avete letto bene, questa non è una normale applicazione, perché qui viaggiamo nel mondo dell’AI.

Lo spiega lo stesso fondatore Goncharov: «abbiamo sviluppato una nuova tecnologia che sfrutta le reti neurali per modificare in maniera realistica il volto nelle foto».

Quello che differenzia la sua applicazione da tutte le altre è il fotorealismo!

In pochissimi secondi, con un clic è possibile modificare il volto: dall’acconciatura, al sesso, fino all’età, dove per quest’ultima (il filtro che ha spopolato sul web) è presente sia la funzione che invecchia che quella che ringiovanisce! Esistono ben 21 filtri diversi in grado di modificare le immagini, di cui alcuni solo nella versione a pagamento (3,99 euro per l’abbonamento mensile; 19,99 euro per quello annuale, 43,99 euro per sempre).

I risultati come detto sono sconvolgenti sia per realismo che per qualità, e questo è il motivo per cui i social (Facebook, Instagram, ecc.), di punto in bianco sono diventati ospizi pieni di vecchietti.

Qui sopra un Fedez e una Ferragni attempati

Qui sopra un Fedez e una Ferragni attempati

Luigi Di Maio e Matteo Salvini in pensione (forse)

Luigi Di Maio e Matteo Salvini in pensione (forse)

Quali sono i pericoli?

Fino a qui nulla da eccepire, soprattutto per i risultati grafici: ma è tutto oro quello che luccica?

Vediamo quindi il rovescio della medaglia e cioè quali potrebbero essere i rischi di un utilizzo non corretto.

Innanzitutto, mentre i sudditi dell’Impero si divertono a vedersi come saranno tra 30 o 50 anni, le loro foto transitano su vari server esteri (dove saranno archiviate e lavorate) sia negli Stati Uniti (dove FaceApp dichiara di avere sede) che in qualunque altro paese dove FaceApp ha affiliati e/o fornitori del servizio (Russia, ecc.).

Quindi queste foto che fine faranno? E per quanto tempo possono tenersele?

La società di Goncharov ovviamente non lo specifica nel sito, non sappiamo per quanto tempo verranno conservate le immagini nei loro hard disk, né dove siano localizzati fisicamente i server.

In ogni caso viene totalmente ignorata la nuova normativa sulla protezione dei dati personali, la tristemente nota Gdpr.

Un dato però è certo: le immagini saranno utilizzate dalle reti neurali come addestramento dell’intelligenza artificiale al riconoscimento facciale, a fini commerciali o anche per altri scopi molto meno positivi. Vediamo quali…

Il sistema che sfrutta la tecnologia alla base delle reti neurali, migliora man mano che analizza volti, sicché più ne finiscono nel loro database e più il sistema diventerà bravo e perfetto nel creare volti «sintetici», volti finti che non esistono, ma così reali da non saperli distinguere.

Il riferimento va alle cosiddette «identità fasulle» che poi possono essere associate a profili social veri e propri!

Oggi è possibile creare un numero impensabile di utenti (Facebook, Instagram, Twitter, ecc.), inventati ma assolutamente credibili e realistici, che possono poi influenzare l’opinione pubblica e pesare anche sulla politica...

Qui non si parla del classico troll con il profilo finto, che scandaglia la Rete per creare zizzania, perché pagato per farlo: il discorso è molto più complesso.

Si chiama DeepFake e tecnicamente è possibile creare un esercito di profili fasulli, arricchiti da foto e video fasulli, ma che sembrano veri.

Un’altra cosetta importante è che stiamo letteralmente regalando i nostri «dati biometrici» a società e aziende di cui non conosciamo nulla. E’ pur vero che lo facciamo già grazie ai social, quando pubblichiamo delle foto che ci ritraggono, ma ora la tecnologia permette di creare i famigerati «DeepFake», ovvero immagini e video falsati impossibili da riconoscere come tali

Il lato oscuro di DeepFake

Questa tecnologia sta facendo molto parlare di sé da qualche anno, anche se non tutti hanno compreso il gravissimo rischio di un suo utilizzo sbagliato.

Il termine deriva da «Deep Learning», che significa «apprendimento profondo» e «Fake» che vuol dire «falso».

Una tecnologia - all’interno del mondo AI - basata sulla sintesi di immagini umane, combinate e sovrapposte dal computer, che usa degli algoritmi di apprendimento non supervisionati (auto-intelligenza) che vanno sotto il nome di GAN: «Generative adversarial network» (Rete generativa avversaria, a base di reti neurali).

Tutti questi paroloni per dire che si possono creare video falsi, ma così realistici che non si può stabilirne a priori la manipolazione.

Quello che è possibile fare con un programma di fotoritocco su una foto, oggi lo si può fare all’interno di un video, riuscendo a far fare e/o far dire al soggetto tutto quello che si vuole!

E’ la stessa tecnologia usata da Hollywood nei film, ma oggi è alla portata di tutti e questo apre scenari impensabili e a dir poco inquietanti.

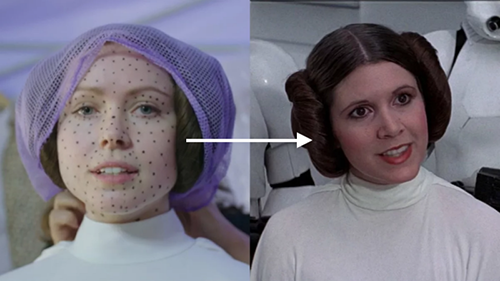

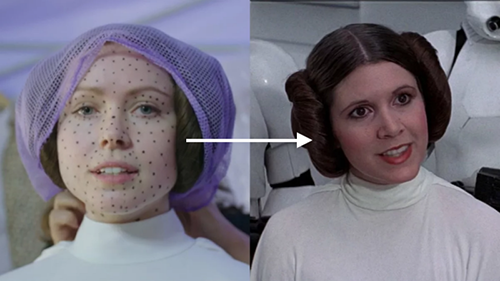

Nel film Rogue One della saga Star Wars (immagine qui sopra), per la principessa Leia hanno utilizzato FakeApp inserendo la faccia di Carrie Fisher (a destra) presa dalla trilogia originale, sopra quella dell'attrice svedese Ingvild Deila (a sinistra) che ha girato le scene.

Nella stessa cinematografia per esempio gli sbocchi di tale applicazione sono tantissimi: ringiovanimento degli attori; creazione di «attori sintetici» mai esistiti prima; possibilità di farli resuscitare nel caso che un attore vero muoia, ecc.

Tanto per capire, ecco cos'è successo poco tempo fa, quando un utente anonimo su Reddit (sito internet di social news e intrattenimento) con il nickname (guarda caso) «Deepfake», ha iniziato a postare una serie di video per adulti, le cui attrici protagoniste erano le bellissime Daisy Ridley e Gal Gadot.

Ma le due star non hanno mai girato nessun film piccante.

Deepfake con Daisy Ridley. Notare la qualità incredibile

Deepfake con Daisy Ridley. Notare la qualità incredibile

Una cosa del genere è stata resa possibile proprio da Deepfake: in pratica i volti delle due porno-attrici che hanno girato il film sono stati sostituiti da quelli della Ridley e della Gadot.

Il risultato è un video verissimo!

La porno attrice ha il volto di Gal Gadot

La porno attrice ha il volto di Gal Gadot

Esistono siti porno dedicati a questo sistema, come per esempio MrDeepfakes, che pubblica film hard con le star più famose del firmamento…

Sito porno dove puoi scegliere l'attrice

Sito porno dove puoi scegliere l'attrice

Oltre al porno però si spalancano portoni molto oscuri.

E’ possibile per esempio prendere un video dalla rete, sostituire il volto con quello della persona che più odiamo (la donna che ci ha lasciato, il titolare del lavoro, ecc.), per farle dire e/o fare quello che vogliamo, per poi rimetterlo in circolazione nel web.

Le ripercussioni sono incalcolabili perché non si riconosce che è falso!

Se a questo aggiungiamo che un’azienda israeliana ha recentemente sviluppato un software che permette di modificare il movimento della bocca di una persona ripresa in un video, il gioco diventa una passeggiata.

I dirigenti di Facebook sono molto preoccupati per la crescita di questo fenomeno (ne sa qualcosa Marck Zuckerberg stesso, come vedremo) e hanno dichiarato che stanno prendendo provvedimenti per limitare al massimo l’uso sbagliato della tecnologia.

E se per caso alla fine le vittime del DeepFake fossimo proprio noi?

Immaginate un futuro in cui con qualche click, alcune foto o video sia possibile creare un DeepFake totalmente convincente per far dire o fare alla nostra vittima quello che vogliamo...

Il paradosso è che, se tutto ciò non verrà fermato, arriveremo al punto che neppure i video catturati dalle telecamere di videosorveglianza costituiranno una prova schiacciante per incastrare un criminale: chi ci assicura infatti che non siano stati manipolati con Deepfake?

Ecco cos'è accaduto al patron di FB...

A metà giugno 2019 Mark Zuckerberg è apparso in un breve video nel quale ha dichiarato: «Immaginatevi per un istante un uomo, con il controllo totale sui dati rubati a milioni di persone. Su tutti i loro segreti, le loro vite e il loro futuro.

Si deve tutto a Spectre.

Spectre mi ha fatto capire che, chi controlla i dati controlla il futuro».

Per il video cliccare sull'immagine, oppure seguire la url : https://www.instagram.com/p/ByaVigGFP2U/?utm_source=ig_embed

Per il video cliccare sull'immagine, oppure seguire la url : https://www.instagram.com/p/ByaVigGFP2U/?utm_source=ig_embed

Parole simili, messe in bocca a chi detiene realmente i dati di miliardi di persone, sono agghiaccianti!

La smentita ufficiale è uscita subito dopo, perché Zuckerberg non ha mai pronunciato quel discorso: era un Deepfake ben fatto e indistinguibile.

Questo semplice esempio dovrebbe farci riflettere e pensare molto seriamente, perché Deepfake potrebbe diventare una minaccia globale per tutti quanti!

Qui sopra un Fedez e una Ferragni attempati

Qui sopra un Fedez e una Ferragni attempati Luigi Di Maio e Matteo Salvini in pensione (forse)

Luigi Di Maio e Matteo Salvini in pensione (forse)

Deepfake con Daisy Ridley. Notare la qualità incredibile

Deepfake con Daisy Ridley. Notare la qualità incredibile La porno attrice ha il volto di Gal Gadot

La porno attrice ha il volto di Gal Gadot